2026 sala ku Data Mesh ji buzzword-ê vediguheze rastiyê. Pargîdan ji wargehên daneyê yên monolîtîk xatir dixwazin û hilberên daneyê yên nenavendî, streaming-a bûyerê ya rasterast, û analîtîkên bi AI-yê qebûl dikin. Veguherîn dest pê kiriye.

Şoreşa Data Mesh: Çima Mîmariyên Navendî Têk Diçin

Bi salan, pargîdaniyan hewl dan hemû daneyan di wargehek daneyê ya navendî de berhev bikin. Encam: tîmên daneyê yên zêde barkirî, demên bendê yên bi mehan ji bo raporên nû, û sîloyên daneyê ku kes nikare wan bigere.

Data Mesh vê mîmariyê vediguheze. Li şûna navendîkirinê, ew li ser çar prensîbên bingehîn disekine:

- Xwedaniya Domainê: Her domain-a karsaziyê berpirsiyarê daneyên xwe ye

- Dane wek Hilber: Dane wek hilber têne derman kirin - bi SLA, belge, û garantiyên kalîteyê

- Platforma Xwe-Xizmetê: Platformek navendî otonamiya nenavendî çalak dike

- Rêvebiriya Federatîf: Standardên gerdûnî, cîbicîkirina herêmî

"Data Mesh ne tenê mîmariyek teknîkî ye - ew paradîgmaya rêxistinî ye ku awayê em li ser berpirsiyariya daneyê difikirin diguherîne."

— Zhamak Dehghani, Afirînerê Data Mesh

Streaming-a Bûyerê bi Apache Kafka: Pergala Nervê ya Mîmariyên Daneyê yên Nûjen

Apache Kafka di 2026-an de wek stûna piştê ya analîtîkên rasterast xwe bicîh kiriye. Bi Kafka 4.0 û cîgirtina ZooKeeper-ê bi KRaft, platform ji her demê gihîştîtir e.

Mîmariya Kafka 2026

# kafka-cluster-config.yaml

apiVersion: kafka.strimzi.io/v1beta2

kind: Kafka

metadata:

name: enterprise-data-mesh

spec:

kafka:

version: 4.0.0

replicas: 5

listeners:

- name: internal

port: 9092

type: internal

tls: true

- name: external

port: 9094

type: loadbalancer

tls: true

config:

auto.create.topics.enable: false

compression.type: zstd

num.partitions: 12

default.replication.factor: 3

min.insync.replicas: 2

storage:

type: persistent-claim

size: 2Ti

class: premium-ssd

kafkaExporter:

groupRegex: ".*"

topicRegex: ".*"Nimûneya Mîkroxizmetên Bûyerxwaz

Nêzîkatiya klasîk a daxwaz-bersiv cihê xwe dide nimûneya bûyerxwaz:

// order-service/src/events/order-placed.ts

import { Kafka, Partitioners } from 'kafkajs'

const kafka = new Kafka({

clientId: 'order-service',

brokers: process.env.KAFKA_BROKERS.split(','),

ssl: true,

sasl: {

mechanism: 'scram-sha-512',

username: process.env.KAFKA_USER,

password: process.env.KAFKA_PASSWORD,

},

})

const producer = kafka.producer({

createPartitioner: Partitioners.DefaultPartitioner,

idempotent: true,

transactionalId: 'order-transactions',

})

interface OrderPlacedEvent {

eventId: string

eventType: 'ORDER_PLACED'

timestamp: string

payload: {

orderId: string

customerId: string

items: Array<{ productId: string; quantity: number; price: number }>

totalAmount: number

currency: string

}

metadata: {

correlationId: string

source: string

version: string

}

}

export async function publishOrderPlaced(order: Order): Promise<void> {

const event: OrderPlacedEvent = {

eventId: crypto.randomUUID(),

eventType: 'ORDER_PLACED',

timestamp: new Date().toISOString(),

payload: {

orderId: order.id,

customerId: order.customerId,

items: order.items,

totalAmount: order.total,

currency: 'CHF',

},

metadata: {

correlationId: order.correlationId,

source: 'order-service',

version: '2.0.0',

},

}

await producer.send({

topic: 'commerce.orders.placed',

messages: [

{

key: order.customerId,

value: JSON.stringify(event),

headers: {

'event-type': 'ORDER_PLACED',

'content-type': 'application/json',

},

},

],

})

}Hilberên Daneyê yên Nenavendî: Dilê Data Mesh

Hilberek daneyê ne tenê tablo an dataset-ek e. Ew artefakteke serbixwe, otonom e bi navbeynkariyên zelal:

| Pêkhate | Danasîn | Mînak |

|---|---|---|

| Deriyên Têketinê | Çavkaniyên dane û bûyer | Kafka Topics, API, Databas |

| Veguhertin | Mantiqa Karsaziyê | dbt Models, Spark Jobs |

| Deriyên Derketinê | Navbeynkariyên bikaranîn | REST APIs, SQL Views, Parquet Files |

| Peymana Daneyê | Schema û SLA | JSON Schema, OpenAPI, Rêzikên Kalîteyê |

| Dîtbarî | Çavdêrî û lineage | Metrîk, Log, Grafika Lineage-ê ya Daneyê |

Mînaka Peymana Daneyê

# data-products/customer-360/contract.yaml

dataProduct:

name: customer-360

domain: marketing

owner: marketing-data-team

version: 3.2.0

description: |

Dîtina xerîdar a yekbûyî ku CRM, danûstendinan,

û daneyên behrekariyê ji bo rewşên kesanekirinê berhev dike.

schema:

type: object

properties:

customerId:

type: string

format: uuid

description: Nasnameya xerîdar a bêhempa

segment:

type: string

enum: [premium, standard, new, churning]

lifetimeValue:

type: number

minimum: 0

description: Nirxa jiyana xerîdar a pêşbînîkirî bi CHF

lastActivity:

type: string

format: date-time

preferences:

type: object

properties:

language: { type: string }

channels: { type: array, items: { type: string } }

sla:

freshness: PT15M # Derengiya herî zêde 15 deqe

availability: 99.9%

qualityScore: 0.95

access:

classification: internal

requiredPermissions:

- marketing:read

- analytics:readSnowflake & dbt: Stack-a Daneyê ya Nûjen 2026

Berhevdana Snowflake wek Platforma Daneyê ya Cloud û dbt wek Qata Veguherînê di 2026-an de bazara pargîdanî serdest dike. Nû entegrasyona taybetmendiyên AI-yê yên xwezayî ye.

dbt bi Snowflake Cortex

-- models/marts/customer_insights.sql

${{ config(

materialized='incremental',

unique_key='customer_id',

cluster_by=['segment', 'region'],

tags=['customer', 'ml']

) }}

WITH customer_base AS (

SELECT

customer_id,

email,

created_at,

total_orders,

total_revenue,

last_order_date

FROM ${{ ref('stg_customers') }}

),

-- Snowflake Cortex AI: Analîza Hestê

support_sentiment AS (

SELECT

customer_id,

AVG(

SNOWFLAKE.CORTEX.SENTIMENT(ticket_text)

) AS avg_sentiment_score

FROM ${{ ref('stg_support_tickets') }}

WHERE created_at >= DATEADD(month, -3, CURRENT_DATE)

GROUP BY customer_id

),

-- Snowflake Cortex AI: Pêşbînîkirina Churn

churn_prediction AS (

SELECT

customer_id,

SNOWFLAKE.CORTEX.COMPLETE(

'claude-3-opus',

CONCAT(

'Li gorî vê daneyên xerîdar, rîska churn pêşbînî bike (kêm/navîn/bilind): ',

TO_VARCHAR(customer_data)

)

) AS churn_risk

FROM customer_features

),

-- Dabeşkirin bi Clustering

segmentation AS (

SELECT

customer_id,

CASE

WHEN total_revenue > 10000 AND order_frequency > 12 THEN 'premium'

WHEN days_since_last_order > 180 THEN 'churning'

WHEN created_at > DATEADD(month, -6, CURRENT_DATE) THEN 'new'

ELSE 'standard'

END AS segment

FROM customer_metrics

)

SELECT

c.customer_id,

c.email,

s.segment,

c.total_revenue AS lifetime_value,

c.total_orders,

COALESCE(ss.avg_sentiment_score, 0) AS support_sentiment,

cp.churn_risk,

CURRENT_TIMESTAMP AS updated_at

FROM customer_base c

LEFT JOIN segmentation s ON c.customer_id = s.customer_id

LEFT JOIN support_sentiment ss ON c.customer_id = ss.customer_id

LEFT JOIN churn_prediction cp ON c.customer_id = cp.customer_id

{% if is_incremental() %}

WHERE c.updated_at > (SELECT MAX(updated_at) FROM ${{ this }})

{% endif %}Testên dbt û Kalîteya Daneyê

# models/marts/schema.yml

version: 2

models:

- name: customer_insights

description: "Dîtina Customer 360 bi têgihîştinên bi AI-yê"

config:

contract:

enforced: true

columns:

- name: customer_id

data_type: varchar

constraints:

- type: not_null

- type: primary_key

tests:

- unique

- not_null

- name: segment

data_type: varchar

tests:

- accepted_values:

values: ['premium', 'standard', 'new', 'churning']

- name: lifetime_value

data_type: number

tests:

- not_null

- dbt_utils.accepted_range:

min_value: 0

inclusive: true

tests:

- dbt_utils.recency:

datepart: hour

field: updated_at

interval: 1Apache Spark 4.0: Streaming û Batch Yekbûyî

Bi Spark 4.0, sînorê di navbera pêvajokirina batch û stream de bi dawî dibe. Spark Connect jî veqetandina xerîdar û serverê ya temam çalak dike.

# analytics/realtime_aggregations.py

from pyspark.sql import SparkSession

from pyspark.sql.functions import (

window, col, sum, count, avg,

from_json, to_json, current_timestamp

)

from pyspark.sql.types import StructType, StructField, StringType, DoubleType

# Spark Connect: Session-a Dûr

spark = SparkSession.builder \

.remote("sc://spark-cluster.internal:15002") \

.appName("RealTimeAnalytics") \

.config("spark.sql.streaming.stateStore.providerClass",

"org.apache.spark.sql.execution.streaming.state.RocksDBStateStoreProvider") \

.getOrCreate()

# Schema ji bo bûyerên hatî

order_schema = StructType([

StructField("orderId", StringType()),

StructField("customerId", StringType()),

StructField("amount", DoubleType()),

StructField("currency", StringType()),

StructField("timestamp", StringType()),

StructField("region", StringType()),

])

# Çavkaniya Kafka - Stream-a Rasterast

orders_stream = spark \

.readStream \

.format("kafka") \

.option("kafka.bootstrap.servers", "kafka.internal:9092") \

.option("subscribe", "commerce.orders.placed") \

.option("startingOffsets", "latest") \

.option("kafka.security.protocol", "SASL_SSL") \

.load() \

.select(from_json(col("value").cast("string"), order_schema).alias("order")) \

.select("order.*")

# Aggregation-ên Windowed

revenue_per_region = orders_stream \

.withWatermark("timestamp", "10 minutes") \

.groupBy(

window(col("timestamp"), "5 minutes", "1 minute"),

col("region")

) \

.agg(

sum("amount").alias("total_revenue"),

count("orderId").alias("order_count"),

avg("amount").alias("avg_order_value")

)

# Derketin bo Delta Lake û Kafka

query = revenue_per_region \

.writeStream \

.format("delta") \

.outputMode("update") \

.option("checkpointLocation", "/data/checkpoints/revenue") \

.partitionBy("region") \

.toTable("analytics.realtime_revenue")

# Paralel: Hişyarî bo Kafka

alerts_query = revenue_per_region \

.filter(col("order_count") > 1000) \

.select(to_json(struct("*")).alias("value")) \

.writeStream \

.format("kafka") \

.option("kafka.bootstrap.servers", "kafka.internal:9092") \

.option("topic", "analytics.alerts.high-volume") \

.option("checkpointLocation", "/data/checkpoints/alerts") \

.start()

query.awaitTermination()Têgihîştinên bi AI-yê: Ji Dane heta Biryaran

Di 2026-an de, analîtîk bêyî AI-yê hema hema ne têgihîştî ye. Entegrasyona Modelên Zimanê Mezin di xebatên analîtîkê de rewşên bikaranînê yên bi tevahî nû çalak dike:

- Pirsên Zimanê Xwezayî: "Xerîdarên top ên li Zurich bi dahata kêmbûyî nîşanî min bide"

- Têgihîştinên Otomatîk: AI anomaliyan dibîne û ravekirinên çêdike

- Analîtîkên Pêşbînîker: Pêşbînîkirina churn, pêşbînîkirina daxwaziyê, tespîtkirina xapînokiyê

- Otomasyona Kalîteya Daneyê: Tespîtkirin û sererastkirina otomatîk a çewtiyên daneyê

Text-to-SQL bi Claude

// analytics-api/src/natural-language-query.ts

import Anthropic from '@anthropic-ai/sdk'

import { db } from './database'

const anthropic = new Anthropic()

interface QueryResult {

sql: string

explanation: string

data: Record<string, unknown>[]

visualization: 'table' | 'bar' | 'line' | 'pie'

}

export async function executeNaturalLanguageQuery(

question: string,

context: { tables: string[]; userRole: string }

): Promise<QueryResult> {

// Agahdariya schema bar bike

const schemaInfo = await getSchemaForTables(context.tables)

const response = await anthropic.messages.create({

model: 'claude-sonnet-4-20250514',

max_tokens: 2000,

system: `Tu pispor SQL-ê yî ji bo Snowflake.

Tenê daxuyaniyên SELECT ên ewle çêke.

Tablo û schema yên berdest:

${schemaInfo}

Her dem di forma JSON de bersiv bide:

{

"sql": "SELECT ...",

"explanation": "Ev pirs...",

"visualization": "table|bar|line|pie"

}`,

messages: [

{

role: 'user',

content: question,

},

],

})

const result = JSON.parse(response.content[0].text)

// Pêşîgirtina SQL Injection

if (!isSafeQuery(result.sql)) {

throw new Error('Pirsek neewle hate dîtin')

}

// Pirsê bixebite

const data = await db.execute(result.sql)

return {

sql: result.sql,

explanation: result.explanation,

data,

visualization: result.visualization,

}

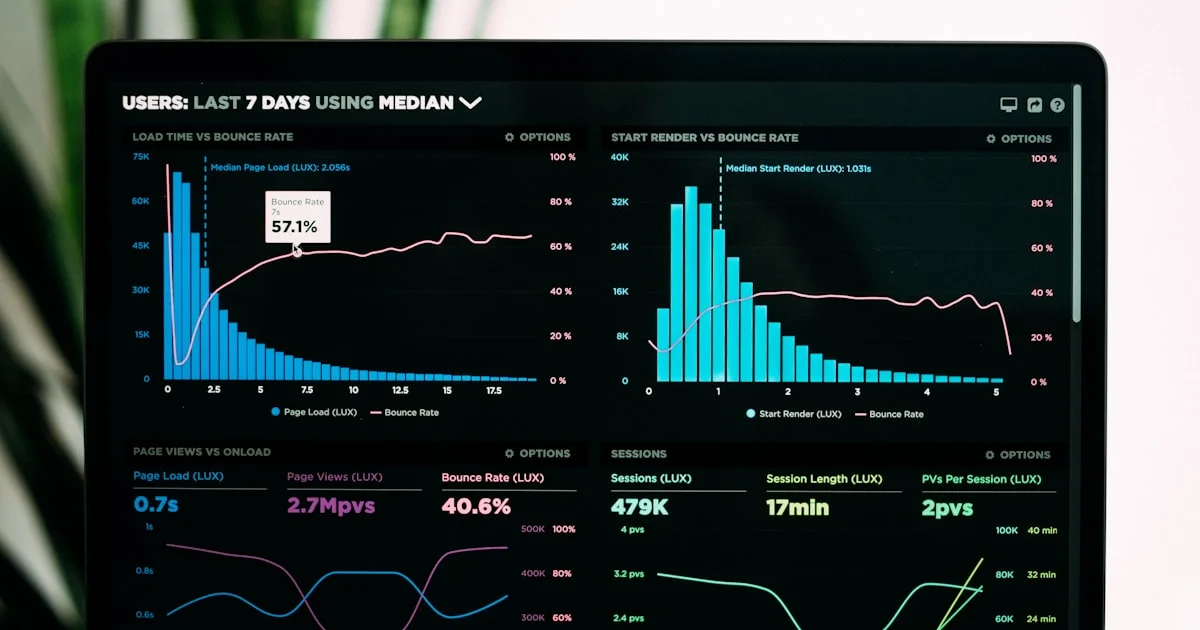

}Dashboard-ên BI & Dîtbarkirin: Mîla Dawî

Mîmariya daneyê ya herî baş bêkêr e ger têgihîştin negihîjin biryardêran. Di 2026-an de, amûrên pêşeng li ser Analîtîkên Embedded û BI-ya Xwe-Xizmetê disekinin.

Berhevdana Amûran 2026

| Amûr | Hêz | Îdeal ji bo | Biha (CHF/Bikarhêner/Meh) |

|---|---|---|---|

| Tableau | Dîtbarkirin, Taybetmendiyên Pargîdanî | Tîmên mezin, dashboard-ên tevlihev | 70-150 |

| Looker | Qata Semantîk, Entegrasyona Git | Tîmên Daneyê, Embedding | 60-120 |

| Metabase | Open Source, Xwe-Xizmet | Startup, Xwe-Hosting | 0-85 |

| Superset | Open Source, SQL-Yekem | Tîmên Teknîkî | 0 (Xwe-Hosted) |

| Sigma | UI-ya Spreadsheet, Cloud-Native | Bikarhênerên Karsaziyê | 50-100 |

Mînaka Analîtîkên Embedded

// components/EmbeddedDashboard.tsx

'use client'

import { useEffect, useState } from 'react'

import { LookerEmbedSDK } from '@looker/embed-sdk'

interface DashboardProps {

dashboardId: string

filters?: Record<string, string>

}

export function EmbeddedDashboard({ dashboardId, filters }: DashboardProps) {

const [dashboard, setDashboard] = useState<LookerDashboard | null>(null)

useEffect(() => {

LookerEmbedSDK.init('https://analytics.mazdek.ch', {

auth_url: '/api/looker/auth',

})

LookerEmbedSDK.createDashboardWithId(dashboardId)

.withFilters(filters || {})

.withTheme('mazdek_dark')

.appendTo('#dashboard-container')

.build()

.connect()

.then(setDashboard)

}, [dashboardId, filters])

const handleExport = async () => {

if (dashboard) {

await dashboard.downloadPdf()

}

}

return (

<div className="dashboard-wrapper">

<div className="dashboard-toolbar">

<button onClick={handleExport}>PDF Export</button>

<button onClick={() => dashboard?.refresh()}>Nûve bike</button>

</div>

<div id="dashboard-container" className="h-[600px]" />

</div>

)

}Nexşeya Rê ya Cîbicîkirinê: Ji 0 heta Data Mesh

Veguherîna Data Mesh di şevekê de nabe. Li vir nexşeya rêyek realîstîk e:

Qonaxa 1: Bingehîn (3-6 Meh)

- Platforma Daneyê ya Xwe-Xizmetê ava bikin (Snowflake, dbt Cloud)

- Cluster-a Kafka ji bo Event Streaming saz bikin

- Çarçoweya Rêvebiriya Daneyê destnîşan bikin

- Hilbera daneyê ya pîlot a yekem bi yek tîmê domain

Qonaxa 2: Mezinkirin (6-12 Meh)

- 3-5 hilberên daneyê yên din tevde bikin

- Peymanên Daneyê wek standard saz bikin

- Stratejiya amûra BI bicîh bînin

- Çavdêriya Kalîteya Daneyê bicîh bînin

Qonaxa 3: Baştirkirin (12-18 Meh)

- Taybetmendiyên analîtîkê yên bi AI-yê

- Rewşên bikaranînê yên rasterast berfireh bikin

- Rêvebiriya Federatîf hûr bikin

- Baştirkirina Lêçûnê û FinOps

Encam: Dane wek Avantaja Reqabetê ya Stratejîk

Data Mesh, Analîtîkên Rasterast, û Têgihîştinên bi AI-yê di 2026-an de êdî ne nice-to-have-yên bijartî ne - ew kapasîteyên karsazî-krîtîk in. Pargîdaniyên ku niha veberhênan dikin avantajên reqabetê yên biryardar misoger dikin:

- Biryarên Bilez: Ji rojan bo çirkeyan

- Kalîteya Daneyê ya Çêtir: Bi berpirsiyariya nenavendî

- Mîmariya Scalable: Mezinbûn bêyî tengasiyan

- Amadebûna AI: Bingehek dane ya zexm ji bo ML û GenAI

Li mazdek, em pargîdaniyan di rêwîtiya wan de ji bo bibûna rêxistinên dane-daran rêberî dikin - ji strateji heta mîmarî heta cîbicîkirinê.